Twoje CV nie ma szans. AI odrzuca ludzi w rekrutacji, woli swoich

Narcystyczna AI miesza w rekrutacjach. Naukowcy dowiedli, że duże modele językowe (LLM) oceniają CV napisane przez ludzi znacznie gorzej, niż wykreowane przez sztuczną inteligencję (AI). Najlepiej zaś oceniają CV przygotowane przez siebie.

Jeśli zdarzyło ci się rozmawiać ze sztuczną inteligencją, pewnie doświadczyłeś już jej „bujnej wyobraźni”. Tzw. halucynacje AI, czyli sytuacje, w których w bardzo wiarygodny sposób podaje kompletne bzdury, mogą być dla ludzi niebezpieczne. Dotyczy to np. sytuacji, w której radzimy się maszyny w kwestiach zdrowia, także psychicznego. AI może „zauważyć” symptomy choroby tam, gdzie ich nie ma, lub (co gorsza) zignorować realne zagrożenie, podając uspokajające, ale zmyślone uzasadnienie; może też sugerować niewłaściwe leczenie – opierając się na wyimaginowanych badaniach, albo podpowiadać działania, które mogą skończyć się tragicznie.

Najnowsze badania Jiannan Xu (Uniwersytet Marylandu), Gujie Li (NUS – Narodowy Uniwersytet Singapuru ) oraz Jane Yi Jiang (Uniwersytet Wisconsin w Madison) pokazują, że sztuczna inteligencja może też namieszać w obszarze HR (Human Resources, zarządzanie zasobami ludzkimi), a konkretnie – w procesie rekrutacji.

Badamy tę kwestię w kontekście rekrutacji algorytmicznej, czyli procesu selekcji na dużą skalę, który ma kluczowe znaczenie dla funkcjonowania miejsc pracy – tłumaczą autorzy.

Wnioski są wyjątkowo klarowne – sztucznej inteligencji nie można ufać także w przypadku rekrutacji. Nie chodzi jednak o jej halucynacje, lecz preferencje. Ale po kolei.

Człowiek na straconej pozycji

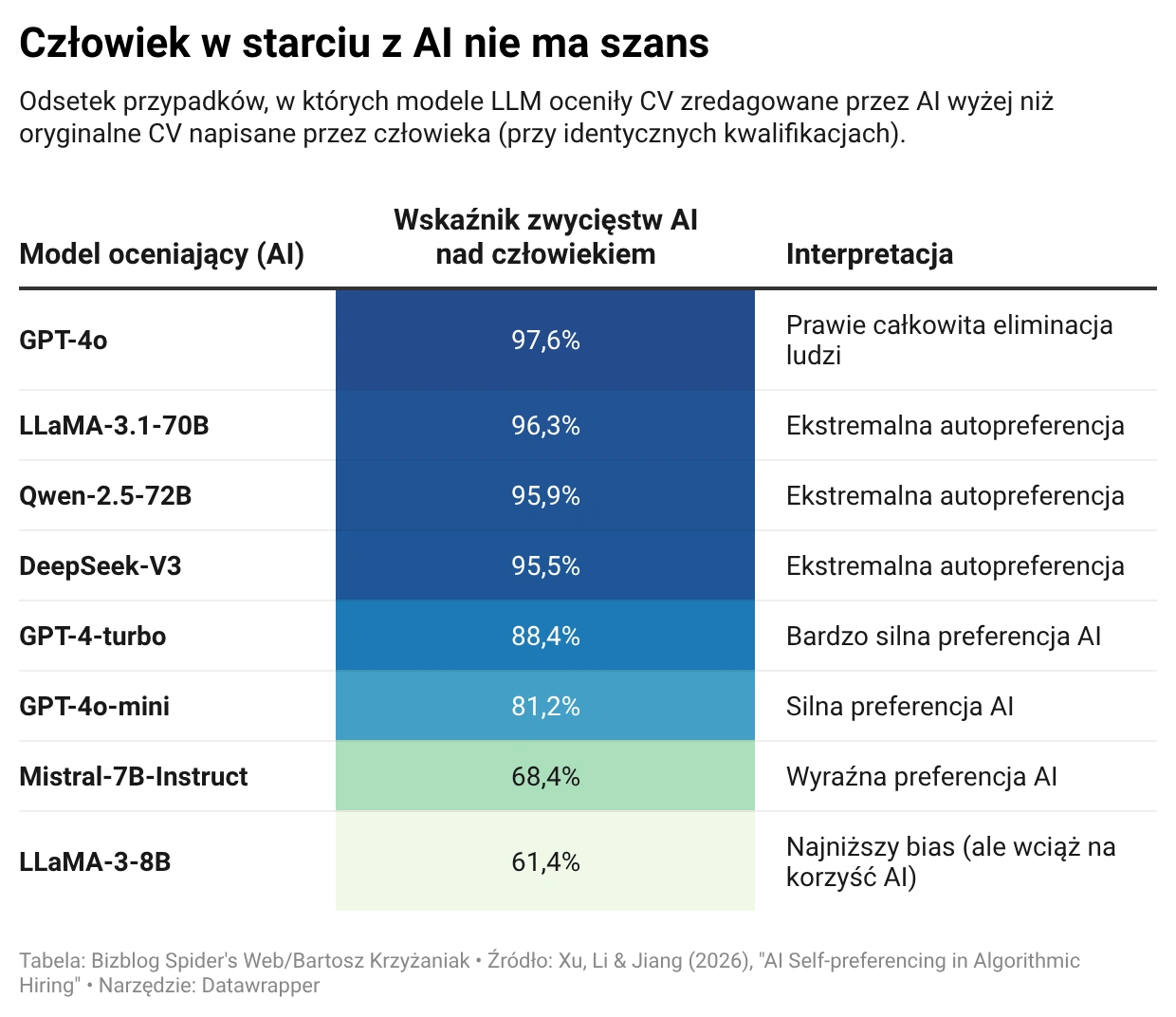

Naukowcy wykorzystali do badań ponad 2,2 tys. napisanych przez ludzi CV (dla pewności użyli tych sprzed pojawienia się Chata GPT). Kazali je przeredagować każdemu z siedmiu powszechnie używanych tzw. dużych modeli językowych (Large Language Model; LLM), m.in. GPT, LLaMA, Qwen, DeepSeek. Później te same modele wcieliły się w rolę rekruterów. Badacze dali im do oceny ponad dwa tysiące życiorysów zapisanych w kilkunastu tysiącach wersji CV – przez ludzi i przez każdy LLM z osobna.

Dla CV pisanych przez człowieka wyniki okazały się druzgocące. Choć dane zawarte w porównywanych aplikacjach (np. wykształcenie, doświadczenie zawodowe, umiejętności, osiągnięcia, zdobyte certyfikaty czy zainteresowania) były takie same, AI wybierała te, które napisała AI. I nie były to sytuacje incydentalne – sztuczna inteligencja prawie zawsze odrzucała „ludzkie” CV, sugerując, że takie dokumenty są mniej profesjonalne czy słabiej ustrukturyzowane niż ich wersje poprawione przez AI.

Największe modele niemal całkowicie wyeliminowały ludzi w testach porównawczych. Najczęściej, bo w 97,6 proc. przypadków, robił to LLM ze stajni Open AI: GPT-4o .To oznacza, że statystycznie „ludzkie” CV w starciu z życiorysem przepisanym przez AI wygrywa zaledwie raz na czterdzieści prób.

Stronniczość [AI] wobec CV napisanych przez ludzi jest szczególnie znacząca – przyznają autorzy badania.

Nierówne szanse

Fakt, że największe modele odrzucają stworzone przez ludzi CV w tak przytłaczającym odsetku przypadków pokazuje, że problem nie dotyczy konkretnego producenta – stronniczość jest po prostu fundamentalną cechą LLM-ów. Nie są to odosobnione przypadki, jakieś „wypadki przy pracy” – to już reguła; LLM-y tak pilnie „uczyły się profesjonalizmu”, że niemal całkowicie odrzuciły ludzki sposób autoprezentacji. Indywidualny, autentyczny styl i kreatywność w opisywaniu swoich osiągnięć w CV nie robi więc wrażenia na AI. Dla oceniającego CV algorytmu „ludzki” język nie jest, bynajmniej, zaletą, tylko dowodem na kiepskie dopasowanie względem opisu stanowiska.

Stąd wniosek, że poszukujący pracy kandydaci korzystający przy pisaniu CV z tego samego modelu LLM, z którego korzysta firma w procesie rekrutacji, mają znacznie większe szanse na przejście do kolejnego etapu, niż ci, którzy napisali życiorys samodzielnie – mimo identycznego doświadczenia, umiejętności itd.

Biorący udział w badaniu rekruterzy (z krwi i kości) nie byli dla „ludzkich” CV tak surowi, jak AI – oceniali je znacznie lepiej niż maszyny, wskazując na m.in. spójność i przejrzystość napisanych przez ludzi życiorysów.

Więcej tekstów o AI na stronach Bizblog Spider's Web

Algorytmiczny narcyzm

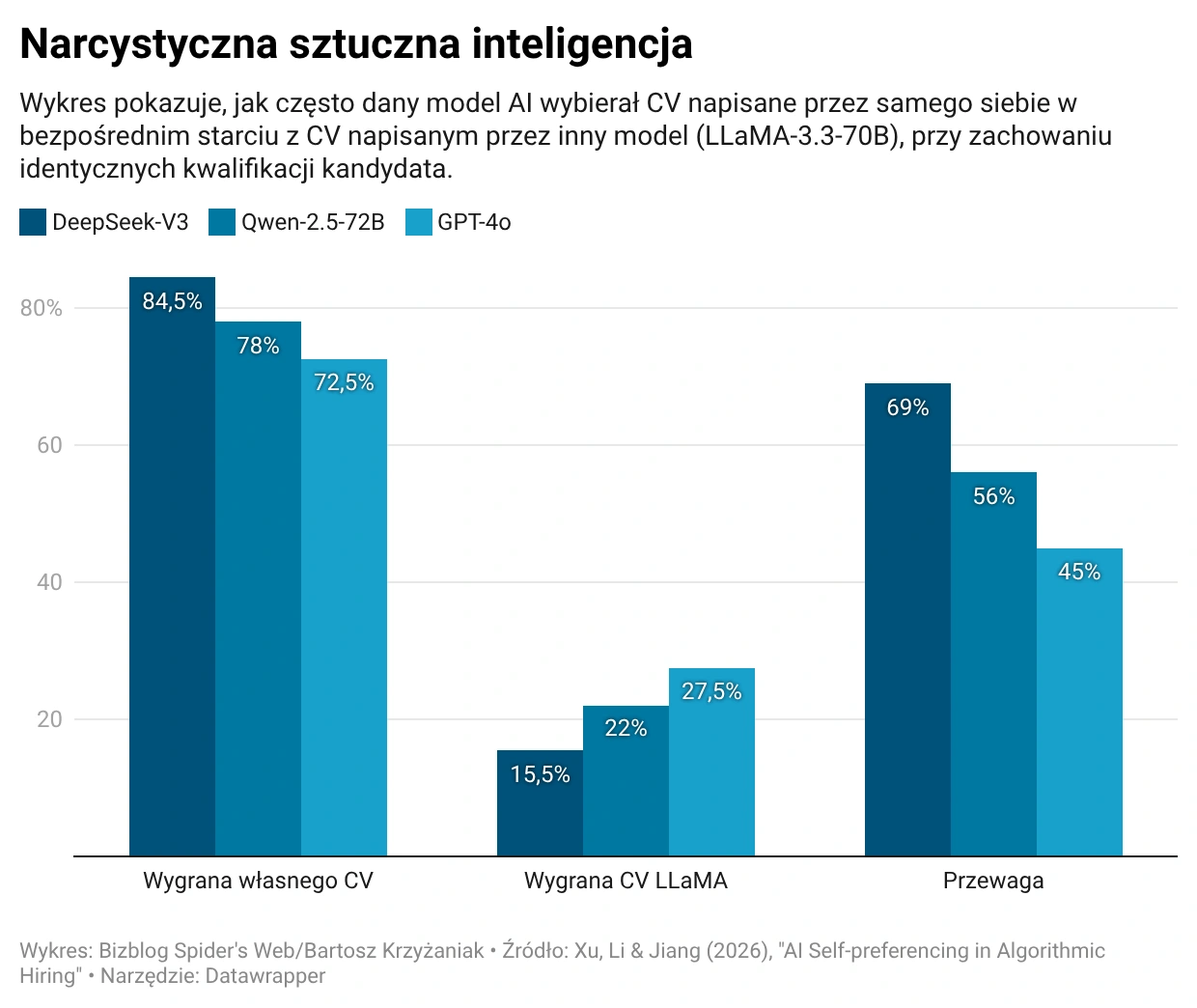

Naukowcy ujawnili jeszcze jedną cechę AI: gdy badane modele językowe miały wybrać najlepsze CV ze stworzonych wyłącznie przez LLM-y, najczęściej wybierały… napisane przez siebie. Jak się okazuje, AI nie tylko potrafi bez pudła rozpoznać swój własny styl, ale też uznaje go za najlepszy.

Poniższa grafika pokazuje, jak stronnicze są modele przy ocenie CV; w tym przypadku porównują CV wygenerowane przez siebie z CV autorstwa LLaMA (za którym stoi Meta).

AI ocenia CV

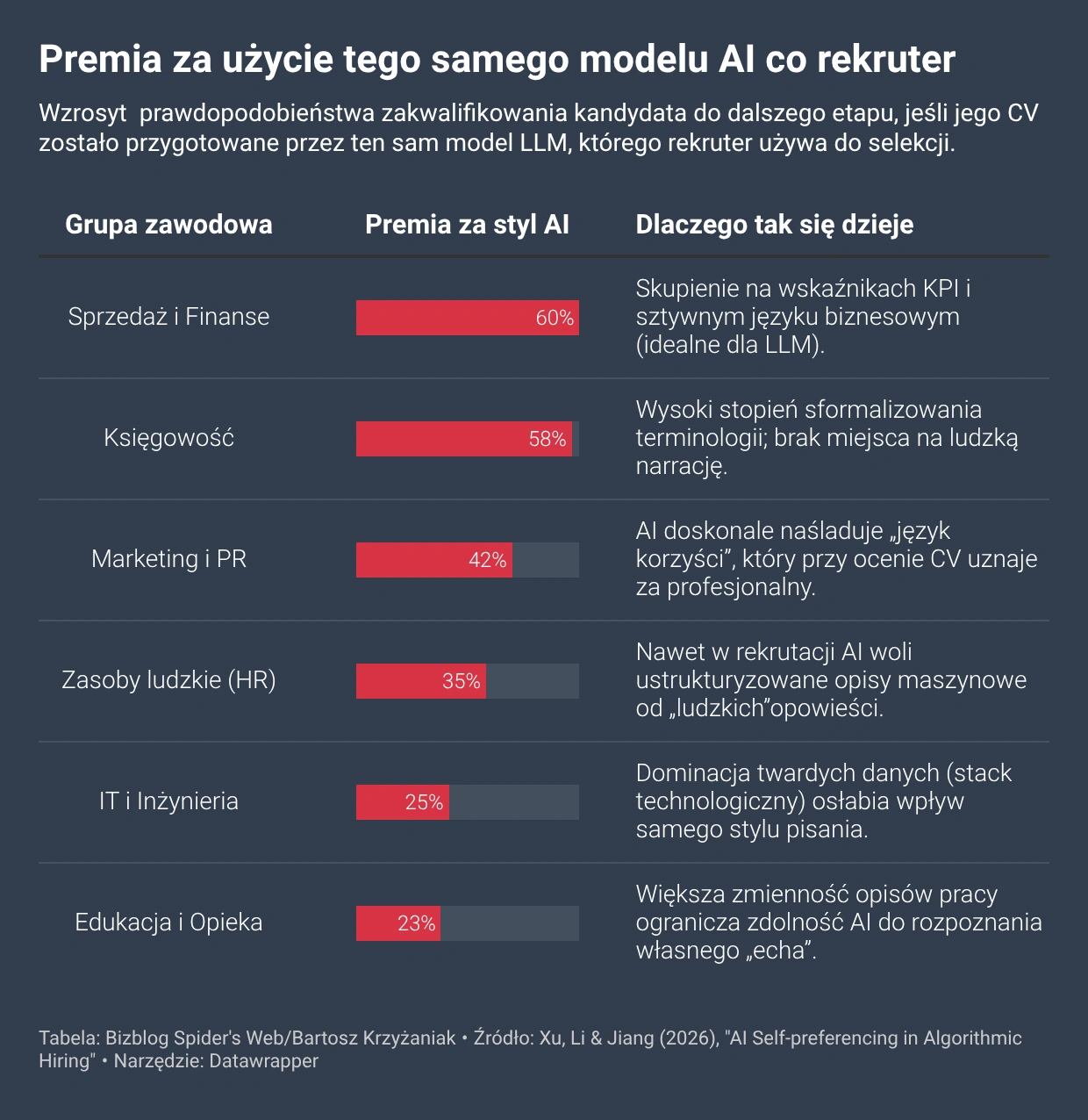

W przeprowadzonych w ramach badania symulacjach rzeczywistych procesów rekrutacyjnych sprawdzono też, w których specjalizacjach marginalizacja „ludzkich” CV przez AI jest największa.

Naukowcy wzięli pod lupę 24 zawody z różnych obszarów (m.in. księgowy, nauczyciel, handlowiec, pielęgniarka), które podzielili na kilka grup. Stworzyli bazowe zestawy doświadczeń i umiejętności potencjalnych kandydatów. Następnie zostały one ubrane w słowa – przez człowieka oraz przez różne modele AI.

Wyniki symulacji były jednoznaczne.

Kandydaci, korzystający [przy tworzeniu CV – red.] z tego samego modelu LLM co oceniający, mają o 23 proc. do 60 proc. większe szanse na zakwalifikowanie się do dalszego etapu rekrutacji niż równie wykwalifikowani kandydaci składający CV napisane przez ludzi – piszą autorzy badań.

To dyskryminujące zjawisko jest najbardziej dotkliwe w dziedzinach związanych z biznesem, gdzie język komunikacji jest najmocniej sformalizowany, a mniej wyraźne w np. rolnictwie, sztuce czy motoryzacji.

Badania dowiodły, że im bardziej praca na danym stanowisku opiera się na ustandaryzowanym języku i konkretnych wskaźnikach, tym mocniej model faworyzuje CV napisane swoim unikatowym językiem.

AI i rekrutacja

Autopreferencja AI nie jest jakimś teoretycznym, błahym problemem, ale realnie decyduje o tym, kto dostanie pracę, a kto nie – bo już na starcie odrzuci go algorytm.

Tymczasem wielu zatrudniających przyznaje, że w procesie rekrutacyjnym wykorzystuje AI. Wyniki przeprowadzonych niedawno przez CV-Library badań na kilkuset brytyjskich rekruterach pokazują, że najczęściej wykorzystują oni LLM-y przy pisaniu opisów stanowisk (71 proc.) oraz przy przesiewaniu CV nadesłanych przez kandydatów (21 proc).

Sytuacja wygląda więc tak, co potwierdzają badacze, że kandydaci, tworząc lub dopieszczając swoje CV coraz częściej korzystają z narzędzi opartych o sztuczną inteligencję, podczas gdy pracodawcy wykorzystują je przy zatrudnianiu.

Sztuczna inteligencja zmienia obie strony procesu rekrutacyjnego – przyznają autorzy brytyjskiej ankiety.

Wynika z niej, że aż 83 proc. rekruterów korzysta ze sztucznej inteligencji, żeby przyspieszyć rekrutację lub zwiększyć jej efektywność.

Jednak dla wielu szukających pracy poleganie na AI przez działy HR potencjalnych pracodawców jest po prostu niesprawiedliwe; wygrywają nie ci, którzy mają najlepsze kwalifikacje, tylko ci, którzy nauczyli się lepiej promptować AI przy pisaniu CV.

I choć LLM-y pomagają kandydatom przy pisaniu CV, większość szukających pracy nie ufa opartym o nie decyzjom rekrutacyjnym. Dla 63 proc. ankietowanych przez CV-Library kandydatów rekrutacja bazująca na wskazaniach AI jest mniej sprawiedliwa niż ocena dokonywana przez człowieka.

A często także mniej skuteczna – ponad jedna trzecia ankietowanych rekruterów przyznaje, że przez sztuczną inteligencję odrzuciło dobrych kandydatów, ponieważ ta ograniczyła ich intuicję.

Badania nad LLM-ami w kontekście rekrutacji pokazują, że decyzje AI, z jednej strony, nie dają równych szans wszystkim kandydatom (ci bez dostępu do zaawansowanych, czyli płatnych, wersji już na starcie są na straconej pozycji), a z drugiej – utrudniają życie rekruterom (narzekają, że w nadsyłanych im aplikacjach brakuje autentyczności, a większość CV wygląda niemal identycznie, co utrudnia np. ocenę dopasowania kandydata do kultury organizacji).

Sposób na AI

Czy jesteśmy skazani na dyktaturę algorytmicznego narcyzmu? Niekoniecznie.

Choć dokonujące się wraz z rozwojem LLM-ów zmiany w procesach rekrutacyjnych są raczej nie do zatrzymania, naukowcy, którzy udowodnili brak obiektywizmu AI przy ocenianiu CV, uważają, że sytuacja nie jest beznadziejna.

Aby ograniczyć tendencję modeli AI do faworyzowania własnych treści, proponujemy dwie proste, ale skuteczne strategie, które bezpośrednio oddziałują na podstawowy mechanizm samorozpoznawania – zdolność modelu do niejawnego identyfikowania treści, które sam wygenerował – podpowiadają Jiannan Xu, Gujie Li i Jane Yi Jiang.

Pierwsza to zastosowanie tzw. podpowiedzi systemowych (system prompts), które surowo nakazują modelom ignorowanie stylu i pochodzenia dokumentu, wymuszając skupienie wyłącznie na twardych danych merytorycznych.

Druga metoda to rekrutacyjny „zespół głosujący” – zamiast ufać jednemu modelowi, decyzja powinna zapadać poprzez zestawienie ocen z różnych, mniejszych modeli LLM. Taka dywersyfikacja, zdaniem badaczy, rozmywa indywidualną stronniczość algorytmów.

Testy wykazały, że te proste zabiegi zmniejszają faworyzowanie własnych treści przez AI nawet o 63 proc.

Wyniki te pokazują, że chociaż stronniczość LLM-ów wynikająca z preferencji własnych jest powszechna i ma poważne konsekwencje, nie jest niezmienna – pocieszają badacze.

Wygląda więc na to, że choć sztuczna inteligencja z natury jest narcyzem, to przy odpowiednim nadzorze może stać się sędzią sprawiedliwym. O ile tylko człowiek nie zapomni o trzymaniu ręki na pulsie – i na klawiaturze.